神经网络的思想

人工智能中神经网络的基本思想和方法来自于生物学,所以我们接下来首先向大家介绍神经元工作的数学表示。

生物学上的神经网络:

神经元主要由细胞体、树突、轴突构成,树突是从其他神经元接收信号的图器,轴突是向其他神经元发送信号的凸起。由树突接受的电信号在细胞体中进行处理之后,通过作为输出装置的轴突被传输到其他神经元。

- 神经元形成神经网络

- 对于从其他多个神经元传过来的信号,如果他们的和不超过某个固定大小的值(阈值),则神经元不做出任何反应。如果超过阈值则,细胞体会输出相应反应,向其他轴突链接的其他神经元传递信号,我们称为点火。

- 对于从其他多个神经元传入的信号具有不同的权重,从而使得对不同的刺激做出不同的反映。但是需要注意,无论刺激大小如何,神经细胞的输出的固定的。

神经网络的数学基础

神经网络的输入与输出

- 来自其他多个神经元的信号之和称为神经元的输入。

- 如果这个信号之和超过神经元固有的阈值,则点火。

- 神经元的输出信号可以使用0,1来表示,即使由多个输出端,其值也是同一个。

其中$\theta$是阈值,当输入和小于$\theta$则无输出,反之则有输出。若使用单位阶跃函数对其进行单位化,那么我们得到:

其中$z=w_{1}x_{1}+w_{2}x_{2}+w_{3}x_{3}+…+w_{n}x_{n}-\theta$

需要注意的一点是神经网络中的神经网络图中输入、输出一定是具有方向的。必须要解释清楚你的每一步是如何做的。

神经网络的激活函数

激活函数是由神经网络的分析者和构建者来给定的,激活函数并不是固定的。需要我们依据自己的任务来确定,接下来我们以Sigmoid函数为例介绍激活函数:

假定存在激活函数u,那么为了便于计算与计算机和数学的统一,我们将$\theta$替换为b,称为bias偏置。

神经网络

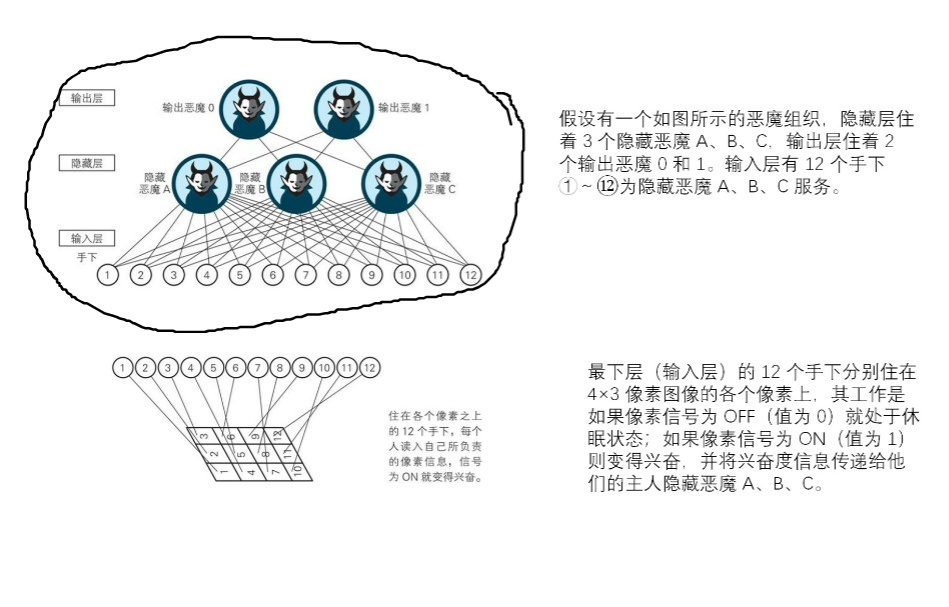

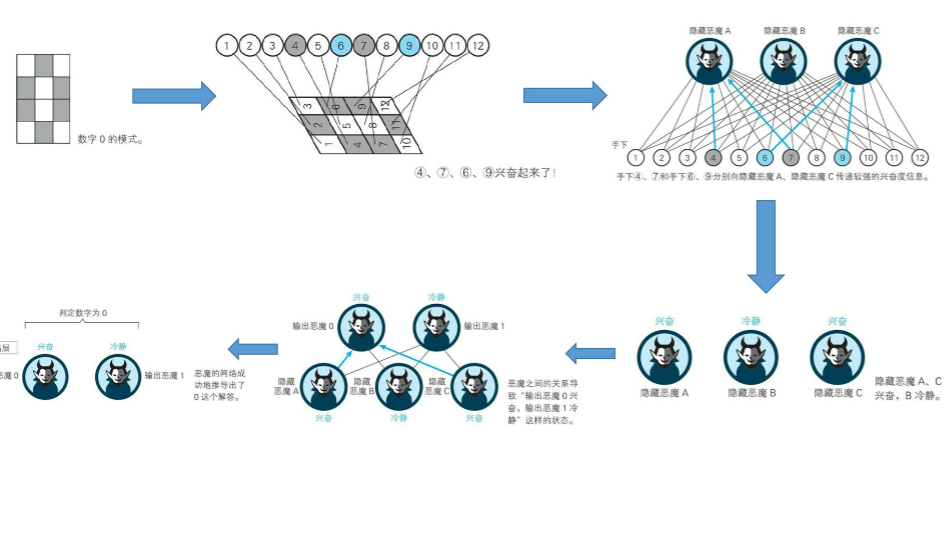

神经网络即是由上述多个神经元组成的网络结构,其中每一个神经元都遵循相同的规则,也就是说神经元之间通过通过输入输出函数互相连接。这种神经元组合连接就形成了神经网络。接下来简单介绍神经网络的各层,其中每一层都对上一层都做了了连接。

神经网络可以分为:输入层,隐藏层,中间层,而深度学习就就是叠加了很多层的神经网络。实际上学习效果并不是累加越多,学习效果就约好,需要依据实际任务确定。

中间层的个数代表了某种特殊的规则,但是这种规则目前尚未可知,暂时没有有效解决手段。无法通过理论推导来得知隐藏层神经元的个数,需要通过实验参考。

神经网络是如何学习的呢?思路机器简单,神经网络得出的预测值,使得预测值与误差总和达到最小的权重和偏置,在数学上称为模型的最优化。在神经网络中我们通过数列的递推关系是来描述各层的。对于神经元的表达式,我们也容易将其简化为向量的形式$z=w\cdot x +c$.

神经网络和误差反向传播法

神经网络Hadamart举证

神经网络网络的导数

神经网络和复合函数

神经网络可以被视作一层层的复合函数

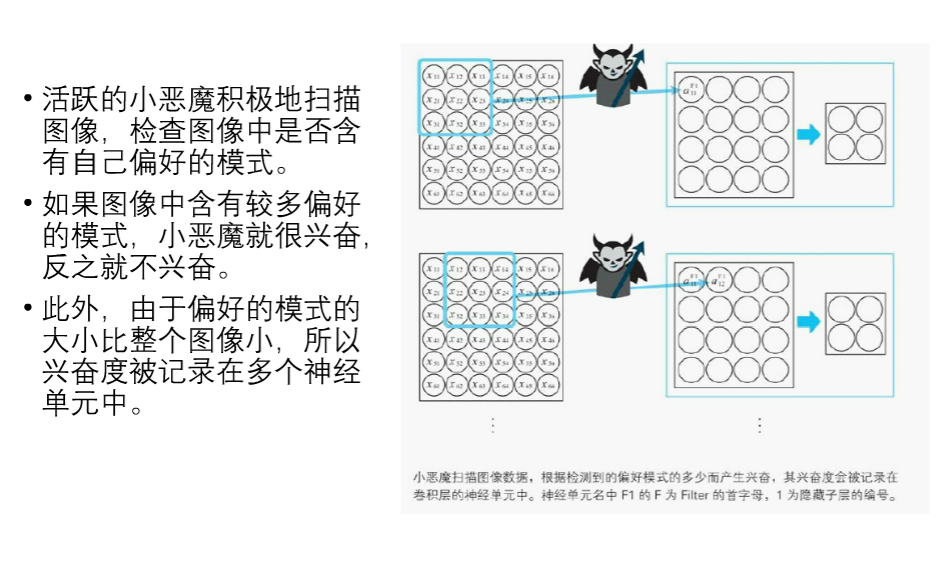

深度学习和卷积神经网络

深度学习是叠加了很多层的神经网络,这样的神经网络使得隐藏层具有一定的结构,从而能够更加有效地进行学习。接下来我们来简单介绍卷积:

我们使用的过滤器一般是5*5的,对于不同的任务我们可以依据自己的需求使用相应大小的过滤器。逐步扫描后我们就能够得到一个据基层的一个子层,并在筛选后我们能够得到池化层。池化层中浓缩了偏好信息。输出层会将上述池化层的结果进行汇总最后得到不同的输出。